Jeffrey Hinton je spolutvůrcem konceptu hlubokého učení, vítěze Turingovy ceny za rok 2019 a inženýra Google. Minulý týden, během I / O vývojové konference, Wired s ním pohovořil a diskutoval o jeho fascinaci mozkem a jeho schopnosti modelovat počítač na základě nervové struktury mozku. Po dlouhou dobu byly tyto myšlenky považovány za šílené. Zajímavá a zábavná konverzace o vědomí, Hintonových budoucích plánech a tom, zda je možné počítače naučit snít.

Co se stane s neuronovými sítěmi?

Začněme dny, kdy jste psali své první, velmi vlivné články. Všichni řekli: „Je to chytrý nápad, ale my nemůžeme takto navrhovat počítače.“Vysvětlete, proč jste trval na svém a proč jste si byli jistí, že jste našli něco důležitého.

Zdálo se mi, že mozek nemůže fungovat jinak. Musí pracovat studováním síly spojení. A pokud chcete, aby zařízení udělalo něco inteligentního, máte dvě možnosti: buď to naprogramujete, nebo se to naučí. A nikdo nenaprogramoval lidi, takže jsme museli studovat. Tato metoda musela být správná.

Vysvětlete, co jsou neuronové sítě. Vysvětlete původní koncept

Berete relativně jednoduché prvky zpracování, které se velmi neurčitě podobají neuronům. Mají příchozí spojení, každé spojení má váhu a tato hmotnost se může během tréninku měnit. Neuron dělá akce na připojeních vynásobené váhami, sečte je a poté rozhodne, zda data odeslat. Pokud je součet zadán dostatečně velký, vytvoří výstup. Pokud je částka záporná, nic neposílá. To je vše. Jediné, co musíte udělat, je spojit mrak těchto neuronů s váhami a přijít na to, jak tyto váhy změnit, a pak udělají cokoli. Jedinou otázkou je, jak změníte hmotnosti.

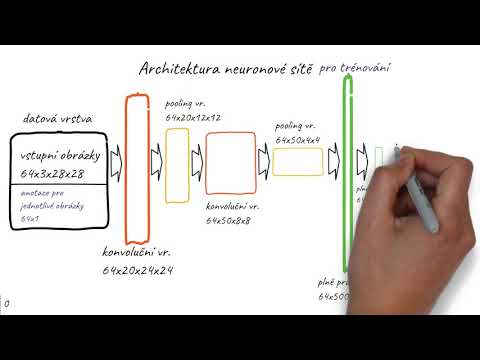

Propagační video:

Kdy jste si uvědomili, že toto je hrubé znázornění toho, jak mozek funguje?

Ano, všechno bylo původně zamýšleno. Navržen tak, aby připomínal mozek při práci.

Takže v určitém okamžiku své kariéry jste začal chápat, jak mozek funguje. Možná vám bylo dvanáct, možná dvacet pět. Kdy jste se rozhodli zkusit modelovat počítače jako mozky?

Ano, okamžitě. To byl celý bod. Celá tato myšlenka měla vytvořit učební zařízení, které se učí jako mozek, podle představ lidí o tom, jak se mozek učí, změnou síly spojení. A to nebyl můj nápad, Turing měl stejný nápad. Přestože Turing vynalezl mnoho základů standardní počítačové vědy, věřil, že mozek je dezorganizované zařízení s náhodnými váhami a používal učení zesílení ke změně spojení, takže se mohl naučit cokoli. A věřil, že toto je nejlepší cesta k inteligenci.

A vy jste sledovali Turingovu myšlenku, že nejlepším způsobem, jak postavit stroj, je navrhnout jej jako lidský mozek. Takto lidský mozek funguje, takže vytvořme podobný stroj

Ano, nejen Turing si to myslel. Mnozí si to mysleli.

Kdy přišly temné časy? Kdy se stalo, že se ostatní lidé, kteří na tom pracovali a věřili, že Turingův nápad je správný, začali ustupovat a pokračovali jste v ohýbání linie?

Vždy existovalo hrst lidí, kteří věřili bez ohledu na to, zejména v oblasti psychologie. Ale mezi počítačovými vědci myslím, že v 90. letech se stalo, že datové sady byly poměrně malé a počítače nebyly tak rychlé. A s malými datovými sadami fungovaly jiné metody, jako např. Podpůrné vektorové stroje, o něco lépe. Ten hluk nebyl tak rozpačitý. Bylo to smutné, protože v 80. letech jsme vyvinuli metodu zpětného šíření, která je pro neuronové sítě velmi důležitá. Mysleli jsme si, že všechno vyřeší. A byli zmatení, že se o ničem nerozhodl. Otázka byla opravdu v měřítku, ale pak jsme to nevěděli.

Proč si myslíš, že to nefunguje?

Mysleli jsme si, že to nefunguje, protože nemáme úplně správné algoritmy a ne zcela správné objektivní funkce. Dlouho jsem si myslel, že je to proto, že jsme se snažili učit pod dohledem, když jste označili data, a když jsme se učili na neznačených datech, museli jsme se učit bez dozoru. Ukázalo se, že otázka byla většinou na stupnici.

To je zajímavé. Problém byl v tom, že nemáte dostatek dat. Mysleli jste si, že máte správné množství dat, ale označili jste je nesprávně. Takže jste právě špatně diagnostikovali problém?

Myslel jsem, že chyba byla v tom, že vůbec používáme štítky. Většina tréninku se odehrává bez použití jakýchkoli štítků, jen se snažíte modelovat strukturu dat. Vlastně si to stále myslím. Myslím si, že protože počítače se zrychlují, pokud je počítač dostatečně rychlý, pak pro jakýkoli datový soubor dané velikosti je lepší trénovat bez dozoru. A jakmile dokončíte učení bez dozoru, můžete se učit s menším počtem značek.

Takže v 90. letech pokračujete ve výzkumu, jste v akademické obci, stále publikujete, ale nevyřešíte velké problémy. Už jste někdy měli okamžik, když jste řekli: „Víš co, to stačí. Pokusím se udělat něco jiného? “Nebo jste si jen řekli, že budete pokračovat v hlubokém učení [tj. V konceptu hlubokého učení, hlubokého učení neuronových sítí

Ano. Něco takového by mělo fungovat. Myslím, že spojení v mozku se nějakým způsobem učí, musíme jen zjistit, jak. A pravděpodobně existuje mnoho různých způsobů, jak posílit propojení v procesu učení; mozek používá jednu z nich. Mohou existovat i jiné způsoby. Ale určitě potřebujete něco, co může posílit tato spojení při učení. Nikdy jsem o tom nepochyboval.

Nikdy jsi o tom nepochyboval. Kdy to vypadalo, jako by to fungovalo?

Jedním z největších zklamání z 80. let bylo, že pokud jsme vytvořili sítě s mnoha skrytými vrstvami, nemohli jsme je trénovat. To není úplně pravda, protože můžete trénovat relativně jednoduché procesy, jako je rukopis. Ale nevěděli jsme, jak trénovat nejhlubší neuronové sítě. A kolem roku 2005 jsem přišel na způsob, jak trénovat hluboké sítě bez dohledu. Zadáváte data, říkáte pixely a trénujete několik detektorů detailů, což jen dobře vysvětlilo, proč byly pixely tak, jak jsou. Poté vložíte data těchto detektorů součástí a zaškolíte jinou sadu detektorů součástí, abychom mohli vysvětlit, proč mají konkrétní detektory součástí specifické korelace. Pokračujete ve výcviku po vrstvách. Ale nejzajímavější bylocož lze matematicky rozložit a prokázat, že pokaždé, když trénujete novou vrstvu, nemusíte nutně vylepšit datový model, ale vypořádáte se s rozsahem toho, jak dobrý je váš model. A tato řada se zlepšila s každou přidanou vrstvou.

Co myslíš tím rozsahem toho, jak dobrý je váš model?

Jakmile model získáte, můžete se zeptat: „Jak neobvyklé tento model najde tato data?“Ukážete jí data a položíte otázku: "Považujete to všechno podle očekávání, nebo je to neobvyklé?" A to by se dalo měřit. Chtěl jsem získat model, dobrý model, který se dívá na data a říká: „Ano, ano. Věděl jsem to. To není překvapivé “. Je vždy velmi obtížné přesně spočítat, jak neobvyklý model najde data. Ale můžete vypočítat rozsah tohoto. Můžeme říci, že tento model bude mít tato data méně neobvyklá. A mohlo by se ukázat, že jak se do detektorů detailů přidává více vrstev, model se vytváří a s každou přidanou vrstvou, když najde data, se rozsah porozumění tomu, jak neobvyklá zjistí, data zlepší.

Kolem roku 2005 jste tedy dosáhli tohoto matematického průlomu. Kdy jste začali dostávat správné odpovědi? S jakými údaji jste pracovali? Váš první průlom byl s řečovými daty, že?

Byly to jen ručně psaná čísla. Velmi jednoduché. A přibližně ve stejnou dobu začal vývoj jednotek GPU (Graphics Processing Units). A lidé, kteří dělali neuronové sítě, začali používat GPU v roce 2007. Měl jsem velmi dobrého studenta, který začal používat GPU k nalezení silnic na leteckých fotografiích. Napsal kód, který pak přijali ostatní studenti pomocí GPU k rozpoznávání fonémů v řeči. Použili tento nápad předškolení. A když byl předběžný výcvik hotový, zavěsili jen značky na vrchol a použili zpětnou propagaci. Ukázalo se, že je možné vytvořit velmi hlubokou síť, která byla dříve vyškolena tímto způsobem. A pak bylo možné použít zpětné propagování a ve skutečnosti to fungovalo. Při rozpoznávání řeči to fungovalo skvěle. Nejprve všaknebylo to o moc lepší.

Bylo to lepší než komerčně dostupné rozpoznávání řeči? Obchází nejlepší vědecké práce o rozpoznávání řeči?

Na relativně malém datovém souboru TIMIT to bylo o něco lepší než nejlepší akademická práce. IBM také odvedla spoustu práce.

Lidé si rychle uvědomili, že to vše - protože to obchází standardní modely, které byly ve vývoji po dobu 30 let - by fungovalo dobře, kdyby se trochu vyvíjelo. Moji absolventi šli do společností Microsoft, IBM a Google a Google velmi rychle vytvořil funkční rozpoznávač řeči. Do roku 2012 tato práce, která byla dokončena v roce 2009, zasáhla Android. Android je najednou mnohem lepší v rozpoznávání řeči.

Povězte mi o chvíli, kdy vy, kteří jste tyto myšlenky uložili 40 let, publikujete toto téma 20 let, najednou obejdete své kolegy. Jaké to je?

V té době jsem tyto myšlenky uložil pouze po dobu 30 let!

Dobře dobře

Byl tu skvělý pocit, že se z toho všeho nakonec stal skutečný problém.

Pamatujete si, kdy jste poprvé obdrželi údaje, které to naznačují?

Ne.

Dobře. Takže máte představu, že to funguje s rozpoznáváním řeči. Kdy jste začali aplikovat neuronové sítě na jiné problémy?

Nejprve jsme je začali aplikovat na všechny další problémy. George Dahl, se kterým jsme původně pracovali na rozpoznávání řeči, je používal k předpovídání toho, zda se molekula může na něco vázat a stát se dobrým lékem. A tam byla soutěž. Prostě použil naši standardní technologii, vytvořenou pro rozpoznávání řeči, k predikci drogové aktivity a vyhrál soutěž. Bylo to znamení, že děláme něco velmi všestranného. Pak se objevil student, který řekl: „Víš, Jeffe, tohle bude fungovat s rozpoznáváním obrazu, a Fei-Fei Li pro to vytvořil vhodný dataset. Existuje veřejná soutěž, udělejme něco. ““

Získali jsme výsledky, které daleko předčily standardní počítačové vidění. Byl rok 2012.

To znamená, že v těchto třech oblastech jste vynikli: modelování chemikálií, řeč, hlas. Kde jsi selhal?

Rozumíte, že neúspěchy jsou dočasné?

Co odděluje oblasti, kde to všechno funguje nejrychleji, a oblasti, kde to trvá nejdéle? Vypadá to, že vizuální zpracování, rozpoznávání řeči a něco jako základní lidské věci, které děláme se smyslovým vnímáním, jsou považovány za první překážky, které je třeba překonat, že?

Ano a ne, protože existují i jiné věci, které děláme dobře - stejné motorické dovednosti. Jsme velmi dobře v řízení motoru. Naše mozky jsou na to rozhodně vybaveny. A teprve nyní začínají neuronové sítě konkurovat nejlepším dalším technologiím. Nakonec vyhrají, ale nyní začínají vyhrávat.

Myslím, že myšlení, abstraktní myšlení je poslední věc, kterou se naučíme. Myslím, že budou mezi posledními věcmi, které se tyto neuronové sítě naučí dělat.

A tak stále říkáte, že neuronové sítě nakonec zvítězí všude

Jsme neuronové sítě. Vše, co můžeme, mohou.

Pravda, ale lidský mozek není zdaleka nejúčinnějším výpočetním strojem, jaký byl kdy postaven

Určitě ne.

Rozhodně ne můj lidský mozek! Existuje způsob, jak modelovat stroje, které jsou mnohem účinnější než lidský mozek?

Filozoficky nemám žádné námitky proti myšlence, že by to mohlo být něco úplně jiného. Možná, že pokud začnete s logikou, zkuste automatizovat logiku, přijít s nějakým efektním provizorním teorémem, důvodem a pak rozhodnout, že právě díky uvažování přijdete k vizuálnímu vnímání, je možné, že tento přístup vyhraje. Ale ještě ne. Na takové vítězství nemám žádné filosofické námitky. Víme jen, že mozek je toho schopen.

Ale existují také věci, které náš mozek nedokáže dobře. Znamená to, že neuronové sítě jim také nebudou schopny udělat dobře?

Docela možná ano.

A existuje zvláštní problém, kterým je, že nechápeme, jak fungují neuronové sítě, že?

Ano, opravdu nechápeme, jak fungují.

Nechápeme, jak fungují neuronové sítě shora dolů. Toto je základní prvek fungování neuronových sítí, kterému nerozumíme. Vysvětlete to a pak mi položte další otázku: pokud víme, jak to funguje, jak to funguje?

Když se podíváte na moderní systémy počítačového vidění, většina z nich se většinou dívá dopředu; nepoužívají připojení zpětné vazby. A v moderních systémech počítačového vidění je ještě něco jiného, které jsou velmi náchylné k protirečivým chybám. Můžete mírně změnit několik pixelů, a to, co byl panda obraz a stále vypadá přesně jako panda, se najednou stanete pštrosem ve vašem chápání neuronové sítě. Je zřejmé, že způsob nahrazování pixelů je promyšlen takovým způsobem, aby přiměl neuronovou síť k přemýšlení o pštrosi. Ale jde o to, že je to pro vás pořád panda.

Zpočátku jsme si mysleli, že to všechno funguje skvěle. Ale pak, tváří v tvář skutečnosti, že se dívali na pandu a byli si jistí, že to byl pštros, jsme se obávali. A myslím si, že součástí problému je, že se nesnaží rekonstruovat z pohledu na vysoké úrovni. Pokoušejí se učit izolovaně, kde se učí pouze vrstvy detektorů detailů, a celkovým cílem je změnit váhy tak, aby byly lepší při hledání správné odpovědi. Nedávno jsme objevili, nebo Nick Frost zjistil, v Torontu, že přidání rekonstrukce zvyšuje odpor vůči odporu. Myslím, že v lidské vizi se rekonstrukce používá k učení. A protože se při rekonstrukci tolik učíme, jsme mnohem odolnější vůči nepřátelským útokům.

Věříte, že navazující komunikace v neuronové síti vám umožní vyzkoušet, jak se něco rekonstruuje. Zkontrolujete to a ujistíte se, že je to panda, ne pštros

Myslím, že je to důležité, ano.

Ale vědci mozku s tím úplně nesouhlasí?

Vědci o mozku netvrdí, že pokud máte v cestě vnímání dvě oblasti kůry, vždy bude existovat obrácené spojení. Oni se dohadují o čem to je. Může to být potřeba pro pozornost, pro učení nebo pro rekonstrukci. Nebo pro všechny tři.

A tak nevíme, co je zpětná vazba. Stavíte své nové neuronové sítě, počínaje předpokladem, že … ne, ani ne - budujete zpětnou vazbu, protože je to nutné k rekonstrukci neuronových sítí, i když ani opravdu nechápete, jak mozek funguje?

Ano.

Není to trik? No, to znamená, že pokud se snažíte udělat něco jako mozek, ale nejste si jisti, jestli to mozek udělá?

Spíš ne. Nejsem ve výpočetní neurovědě. Nesnažím se modelovat, jak mozek funguje. Dívám se na mozek a říkám: „Funguje to, a pokud chceme udělat něco jiného, co funguje, musíme se na něj dívat a nechat se inspirovat.“Jsme inspirováni neurony, ne budujeme nervový model. Celý model neuronů, který používáme, je tedy inspirován skutečností, že neurony mají mnoho spojení a že mění váhy.

To je zajímavé. Kdybych byl počítačový vědec pracující na neuronových sítích a chtěl by obejít Jeffa Hintona, jednou z možností by bylo vybudovat sestupnou komunikaci a založit ji na jiných modelech mozkové vědy. Na základě školení, nikoli rekonstrukce

Pokud by existovaly lepší modely, vyhráli byste. Ano.

Je to velmi, velmi zajímavé. Pojďme se dotknout obecnějšího tématu. Neuronové sítě tedy mohou vyřešit všechny možné problémy. Existují v lidském mozku hádanky, které neuronové sítě nemohou nebo nemohou pokrýt? Například emoce

Ne.

Takže láska může být rekonstruována neuronovou sítí? Vědomí lze rekonstruovat?

Absolutně. Jakmile zjistíte, co tyto věci znamenají. Jsme neuronové sítě, že? Vědomí je pro mě obzvláště zajímavé téma. Ale … lidé opravdu nevědí, co znamenají tímto slovem. Existuje mnoho různých definic. A myslím, že je to docela vědecký termín. Pokud se tedy před 100 lety ptáte lidí: co je život? Odpověděli: „No, živé věci mají životní sílu, a když umřou, životní síla je opustí. To je rozdíl mezi živými a mrtvými, ať už máte vitalitu, nebo nemáte. “Nyní nemáme žádnou životní sílu, myslíme si, že tento koncept přišel před vědu. A jakmile začnete chápat něco o biochemii a molekulární biologii, už nepotřebujete životní sílu, pochopíte, jak to všechno funguje. A totéž se, myslím, stane s vědomím. Myslím,že vědomí je pokus vysvětlit mentální jevy pomocí entity. A tato podstata není nutná. Jakmile to dokážete vysvětlit, můžete vysvětlit, jak děláme vše, co nutí lidi, aby si uvědomili bytosti, vysvětlili různé významy vědomí, aniž by zahrnuli jakékoli zvláštní entity.

Ukazuje se, že neexistují žádné emoce, které by nemohly být vytvořeny? Není žádná myšlenka, kterou nelze vytvořit? Lidská mysl není schopna toho, co by teoreticky nemohlo být vytvořeno plně fungující neuronovou sítí, jakmile skutečně pochopíme, jak mozek funguje?

John Lennon zpíval něco podobného v jedné ze svých písní.

Jste si tím stoprocentně jistí?

Ne, jsem Bayesian, takže jsem si jistý 99,9%.

Dobře, co je tedy 0,01%?

Mohli bychom například být součástí větší simulace.

Dost spravedlivé. Co se tedy dozvíme o mozku z naší práce na počítačích?

Myslím, že z toho, co jsme se naučili za posledních 10 let, je zajímavé, že pokud vezmete systém s miliardami parametrů a objektivní funkcí - například vyplněním mezery v řadě slov - funguje to lépe, než by mělo. Bude to fungovat mnohem lépe, než byste čekali. Můžete si myslet, a mnoho lidí v tradičním výzkumu AI by si mohlo myslet, že si můžete vzít systém s miliardou parametrů, spustit ho v náhodných hodnotách, změřit gradient objektivní funkce a pak ji vylepšit, abyste vylepšili objektivní funkci. Možná si myslíte, že by se beznadějný algoritmus nevyhnutelně zasekl. Ale ne, ukázalo se, že je to opravdu dobrý algoritmus. A čím větší je měřítko, tím lépe to funguje. A tento objev byl v podstatě empirický. Samozřejmě za ní byla nějaká teorie, ale objev byl empirický. A teď,protože jsme to našli, zdá se pravděpodobnější, že mozek vypočítává gradient některé objektivní funkce a aktualizuje váhy a sílu synaptického spojení, aby držel krok s tímto gradientem. Musíme jen zjistit, co je tato cílová funkce a jak se zhoršuje.

Ale my jsme tomu nerozuměli na příkladu mozku? Nerozumíte aktualizaci zůstatku?

Byla to teorie. Lidé si dávno mysleli, že je to možné. Ale v pozadí byli vždy někteří počítačoví vědci, kteří říkali: „Ano, ale myšlenka, že všechno je náhodné a učení je způsobeno sestupným klesáním, nebude fungovat s miliardovými parametry, musíte připojit spoustu znalostí.“Nyní víme, že tomu tak není. Stačí zadat náhodné parametry a naučit se vše.

Pojďme se ponořit trochu hlouběji. Jak se stále více učíme, pravděpodobně se budeme stále více učit o tom, jak lidský mozek funguje, když provádíme masivní testy modelů na základě našeho porozumění mozkové funkce. Až to všechno pochopíme lépe, bude v místě, kde v podstatě převedeme naše mozky, aby se staly mnohem účinnějšími stroji?

Pokud opravdu pochopíme, co se děje, můžeme zlepšit některé věci, jako je vzdělávání. A myslím, že se zlepšíme. Bylo by velmi podivné konečně pochopit, co se děje ve vašem mozku, jak se to učí, a nepřizpůsobovat se tak, aby se učilo lépe.

Jak si myslíte, že za pár let použijeme to, co jsme se naučili o mozku a jak hluboké učení funguje k transformaci vzdělávání? Jak byste změnil třídy?

Nejsem si jistý, že se za pár let toho hodně naučíme. Myslím, že to bude trvat déle, než se změní vzdělání. Ale když už o tom mluvíme, [digitální] asistenti jsou docela chytří. A když asistenti rozumějí konverzacím, mohou mluvit a vzdělávat děti.

A teoreticky, pokud lépe rozumíme mozku, můžeme programovým pomocníkům lépe komunikovat s dětmi na základě toho, co se již naučili

Ano, ale moc jsem o tom nepřemýšlel. Dělám něco jiného. Ale to vše se zdá docela podobné pravdě.

Dokážeme pochopit, jak sny fungují?

Ano, velmi mě zajímají sny. Zajímá mě, že mám alespoň čtyři různé teorie snů.

Řekněte nám o nich - o první, druhé, třetí, čtvrté

Kdysi dávno tu byla taková věc nazývaná sítě Hopfield a studovali vzpomínky jako místní přitažlivosti. Hopfield zjistil, že pokud se pokusíte vložit příliš mnoho vzpomínek, dostanou zmatek. Vezmou dva místní atraktory a spojí je do jednoho atraktora někde na půli cesty mezi nimi.

Potom přišli Francis Crick a Graham Mitchison a řekli, že se těchto falešných minim můžeme zbavit učením (tj. Zapomínáme na to, co jsme se naučili). Vypneme vstup dat, uvedeme neuronovou síť do náhodného stavu, necháme ji uklidnit, řekneme, že je to špatné, změníme připojení tak, aby nespadla do tohoto stavu, a tak můžeme donutit síť ukládat více vzpomínek.

Potom jsme s Terrym Seinowskim vstoupili a řekli: „Podívej, pokud máme nejen neurony, které uchovávají vzpomínky, ale spoustu dalších neuronů, můžeme najít algoritmus, který používá všechny tyto další neurony, aby pomohl vzpomenout si vzpomínky?“… Výsledkem bylo vytvoření algoritmu strojového učení Boltzmann. A Boltzmannův algoritmus strojového učení měl extrémně zajímavou vlastnost: ukazuji data, a to druhem prochází zbývající jednotky, dokud se nedostane do velmi šťastného stavu, a poté zvyšuje sílu všech spojení, na základě skutečnosti, že dvě jednotky jsou aktivní současně.

Také byste měli mít fázi, ve které vypnete vstup, nechte algoritmus „šustit“a uvést ho do stavu, ve kterém je šťastný, aby fantazíroval, a jakmile má fantazii, řeknete: „Vezměte všechny páry neuronů které jsou aktivní a snižují sílu spojení. “

Algoritmus ti vysvětlím jako postup. Ale ve skutečnosti je tento algoritmus produktem matematiky a otázkou: „Jak musíte změnit tyto řetězce spojení, aby tato neurální síť se všemi těmito skrytými jednotkami dat nebyla překvapující?“A měla by také existovat další fáze, kterou nazýváme zápornou fází, když síť pracuje bez zadávání dat a odučí se, bez ohledu na to, v jakém stavu jej vložíte.

Každou noc sníme mnoho hodin. A pokud se najednou probudíte, můžete říci, že jste právě snili, protože sen je uložen v krátkodobé paměti. Víme, že vidíme sny na mnoho hodin, ale ráno, po probuzení, si můžeme vzpomenout pouze na poslední sen a na ostatní si nevzpomínáme, což je velmi úspěšné, protože je lze mýlit za realitu. Tak proč si vůbec nepamatujeme naše sny? Podle Cricka to je význam snů: odcizit tyto věci. Dozvíte se to naopak.

Terry Seinovski a já jsme ukázali, že toto je ve skutečnosti maximální pravděpodobnost postupu učení pro stroje Boltzmann. Toto je první teorie o snech.

Chci přejít k vašim dalším teoriím. Ale moje otázka zní: Dokázali jste vycvičit některý z vašich algoritmů hlubokého učení, aby se ve skutečnosti sní?

Některé z prvních algoritmů, které se mohly naučit pracovat se skrytými jednotkami, byly Boltzmannovy stroje. Byli velmi neefektivní. Později jsem však našel způsob, jak pracovat s aproximacemi, které se ukázaly jako efektivní. A to vlastně sloužilo jako podnět k obnovení práce s hlubokým učením. To byly věci, které trénovaly jednu vrstvu detektorů funkcí najednou. A to byla účinná forma Boltzmannova omezujícího stroje. A tak učinila tento druh zpětného učení. Ale místo toho, aby usnula, mohla jen trochu snít po každé datové značce.

Dobře, takže androidi vlastně sní o elektrických ovcích. Pojďme k teorii dvě, tři a čtyři

Teorie dva se jmenovala Algoritmus probuzení spánku. Musíte trénovat generativní model. A máte nápad vytvořit model, který dokáže generovat data, má vrstvy detektorů prvků a aktivuje vyšší a dolní vrstvy atd., Až po aktivaci pixelů - v podstatě se vytvoří obrázek. Ale chtěli byste ji naučit něco jiného. Chtěli byste, aby data rozpoznávala.

A tak musíte vytvořit algoritmus se dvěma fázemi. Ve fázi probuzení přicházejí data, snaží se je rozpoznat, a místo studia spojení, které používá pro rozpoznávání, studuje generativní spojení. Data přicházejí, aktivuji skryté jednotky. A pak se pokusím tyto skryté jednotky naučit tyto údaje obnovit. Naučí se rekonstruovat v každé vrstvě. Otázkou však je, jak se naučit přímé souvislosti? Myšlenka je taková, že pokud jste znali přímá spojení, mohli byste se naučit zpětným spojům, protože byste se mohli naučit zpětného inženýra.

Nyní se také ukáže, že pokud používáte zpětné spojení, můžete se také naučit přímé spojení, protože stačí začít nahoře a generovat některá data. A protože generujete data, znáte stavy všech skrytých vrstev a můžete studovat přímá připojení k obnovení těchto stavů. A tady je to, co se stane: pokud začnete s náhodným připojením a pokusíte se střídavě používat obě fáze, uspějete. Aby to fungovalo dobře, musíte vyzkoušet různé možnosti, ale bude to fungovat.

Dobře, a co další dvě teorie? Zbývá nám jen osm minut, myslím, že nebudu mít čas se na všechno zeptat

Dej mi další hodinu a povím ti o dalších dvou.

Pojďme mluvit o tom, co bude dál. Kam směřuje váš výzkum? Jaké problémy se snažíte vyřešit teď?

Nakonec budete muset pracovat na něčem, co tato práce ještě neskončila. Myslím, že možná budu pracovat na něčem, co nikdy nedokončím - tzv. Kapsle, teorie o tom, jak se vizuální vnímání provádí pomocí rekonstrukce a jak jsou informace nasměrovány na správná místa. Dva hlavní motivační faktory byly to, že ve standardních neuronových sítích je informace, aktivita ve vrstvě, někde automaticky zaslána, a vy neuděláte rozhodnutí, kam ji poslat. Myšlenkou kapslí bylo rozhodnout, kam zaslat informace.

Nyní, když jsem začal pracovat na kapslích, vyvinuli velmi chytrí lidé na Googlu transformátory, které dělají totéž. Rozhodují se, kam informace zaslat, a to je velká výhra.

Vrátíme se příští rok, abychom si povídali o teoriích snů číslo tři a číslo čtyři.

Ilya Khel